现在一句口令,就能指挥汽车了。

比如说声“我开会要迟到了”“我不想让我朋友等太久”等等,车就能理解,并且自动加速起来。

如果这次行程有不满意的,只需要给汽车提供反馈建议:“要在充分保障安全的前提下”,汽车的自动驾驶行为就会在下次行程中进行自我修正。

这是来自普渡大学数字孪生实验室最新研究——

让大语言模型部署在自动驾驶实车上,在多个交通场景,比如停车场、十字路口和高速上理解乘客的各种个性化指令,构建他们的数字孪生。

最终在众多大模型的实验中,GPT-4脱颖而出。

基于LLM的自动驾驶系统

而这背后的实现,主要来自于一个框架Talk2Drive。

这个框架主要有三个特点:

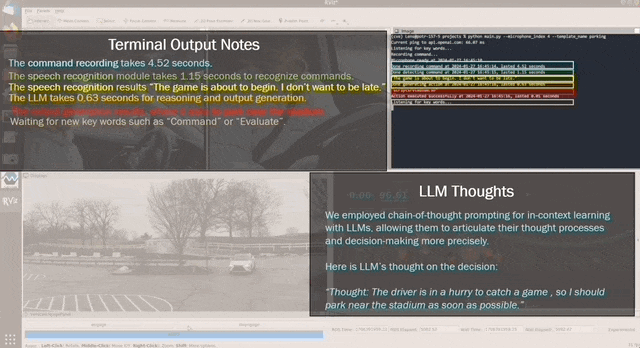

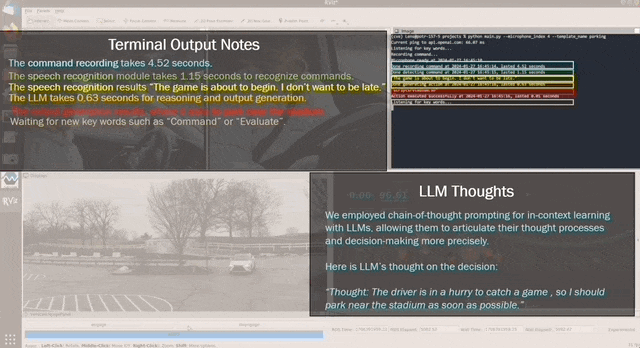

1、它将人类口头命令转换为文本指令,然后由云端的大模型来处理。在此过程中会用到一些语音识别的开源API,比如Whisper,准确捕获口令并翻译成文本。云上的大模型结合天气、交通状况和当地交通规则等信息,生成上下文驾驶数据。

2、大模型生成特定的自动驾驶代码,随后发送回车辆的电子控制单元(ECU)并在其中执行。

代码执行涉及调整基本驾驶行为以及车辆规划和控制系统中的各种参数。

随后,车辆的执行器通过CAN总线和线控系统控制油门、刹车、档位选择和转向。

3、车辆的存储模块秉承”千人千面“的理念,记录着所有人车交互数据,确保每次行驶体验都是基于乘客的历史偏好和实时命令进行定制,实现真正意义上的数字孪生个性体验。

经过一众大模型对比,他们最终选择GPT-4,因为它的延迟相对较小,以及推理能力更强。

在Talk2Drive 系统中,三类不同驾乘偏好的乘客以口头化的指令表达与大模型进行交互,以促使系统做出相应调整。当乘客对调整后的自动驾驶行为不满意时会关闭自动驾驶模式,系统也会记录这种情况下的 “接管”。

结果显示,无论驾乘偏好如何,Talk2Drive都能显著降低接管率。

这辆全副武装的自动驾驶车和大语言模型API协作完成了这次研究。

来自普渡大学数字孪生实验室

这项研究来自普渡大学数字孪生实验室。

从研究团队来看,大部分都是华人面孔。

其中一作Can Cui目前是普渡大学一年级博士生。在加入普渡大学工程学院之前,在密歇根大学获得了电气与计算机工程硕士学位。本科毕业于武汉理工大学。

其导师王子然博士,在2022年加入普渡大学之前,曾在丰田硅谷研发中心任职四年,以主任研究员的身份领衔数字孪生的相关研究。

据介绍,普渡数字孪生实验室从2023年6月开始深耕大语言模型和自动驾驶交叉领域,进行了包括文献综述、创立公开数据集、仿真环境测试、以及主办研讨会等一系列工作。

论文链接:

https://arxiv.org/abs/2312.09397

项目网站:

https://purduedigitaltwin.github.io/llm4ad

文章来自微信公众号 ” 量子位 “,作者 白交

发评论,每天都得现金奖励!超多礼品等你来拿

登录 后,在评论区留言并审核通过后,即可获得现金奖励,奖励规则可见: 查看奖励规则