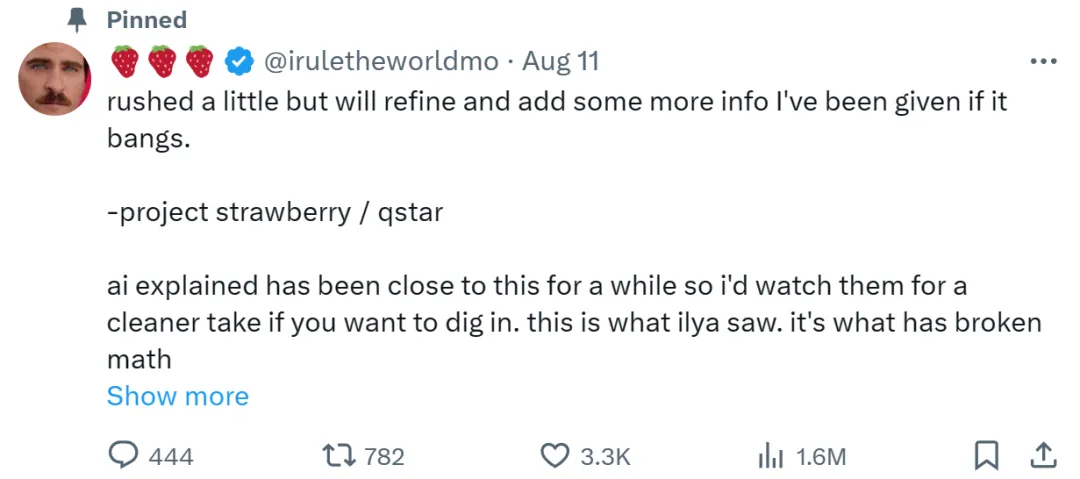

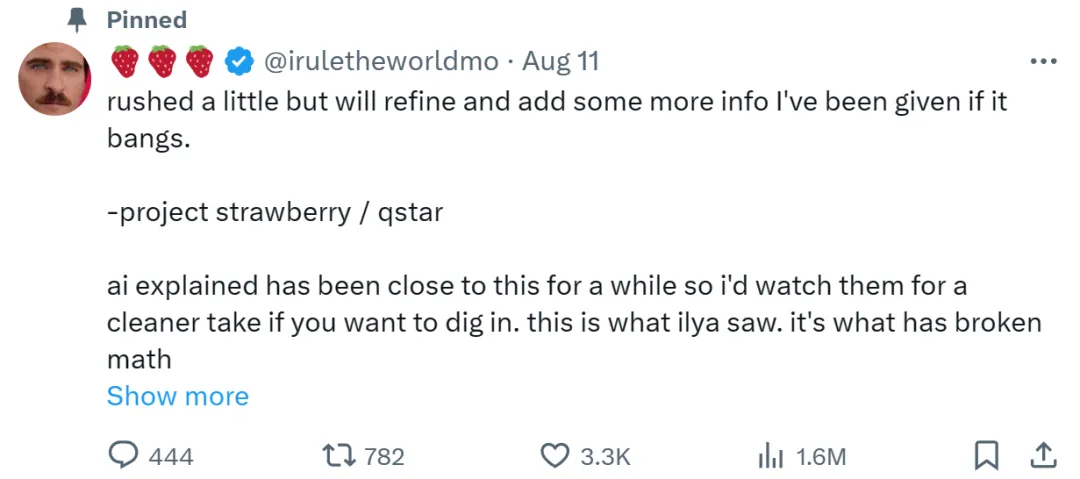

最近,OpenAI 的秘密项目「Q*」一直受到了圈内人士的广泛关注。上个月,以它为前身、代号为「草莓(Strawberry)」的项目又被曝光了。据推测,该项目能够提供高级推理能力。

最近几天,关于这个项目,网络上又来了几波「鸽死人不偿命」的传播。尤其是一个「草莓哥」的账号,不间断地宣传,给人期望又让人失望。

没想到,这个 Sam Altman 出现在哪里,它就在哪里跟帖的「营销号」,皮下竟然是个智能体?

今天,一家 AI 智能体初创公司「MultiOn」的创始人直接出来认领:虽然没等来 OpenAI 发布「Q*」,但我们发了操控「草莓哥」账号的全新智能体 Agent Q,快来和我们在线玩耍吧!

这波看起来让 OpenAI 给自己做嫁衣的营销操作给大家都看懵了。毕竟,最近很多人彻夜未眠等待 OpenAI 的「大新闻」。这要追溯到 Sam Altman 和「草莓哥」的互动,在 Sam Altman 晒出的草莓照

片下,他回复了「草莓哥」:惊喜马上就来。

不过,「MultiOn」的创始人 Div Garg 已经把认领 Agent Q 就是「草莓哥」的帖子悄悄删了。

此次,「MultiOn」宣称,他们发布的 Agent Q 是一款突破性的 AI 智能体。它的训练方法结合了蒙特卡洛树搜索(MCTS)和自我批评,并且通过一种叫做直接偏好优化(DPO)的算法来学习人类的

反馈。

与此同时,作为拥有规划和 AI 自我修复功能的下一代 AI 智能体,Agent Q 的性能是 LLama 3 基线零样本性能的 3.4 倍。同时,在真实场景任务的评估中,Agent Q 的成功率达到了 95.4%。

Agent Q 能做什么呢?我们先来看一下官方 Demo。

它能够为你预定某个时间某家餐厅的座位。

然后为你执行网页操作,比如查询空位情况。最终成功预定。

此外还能预定航班(比如本周六从纽约飞往旧金山,单程、靠窗和经济舱)。

不过,网友似乎对 Agent Q 并不买账。大家关心更多的还是他们是否真的借「草莓哥」账号炒作的事情,甚至有些人称他们为无耻的骗子。

目前,Agent Q 的相关论文已经放出,由 MultiOn 和斯坦福大学的研究者联合撰写。这项研究的成果将在今年晚些时候向开发人员和使用 MultiOn 的普通用户开放。

总结一波:Agent Q 能够自主地在网页上实施规划并自我纠错,从成功和失败的经验中学习,提高它在复杂任务中的表现。最终,该智能体可以更好地规划如何在互联网上冲浪,以适应现实世界的

复杂情况。

在技术细节上, Agent Q 的主要组件包括如下:

使用 MCTS(Monte Carlo Tree Search,蒙特卡洛树搜索)进行引导式搜索:该技术通过探索不同的操作和网页来自主生成数据,以平衡探索和利用。MCTS 使用高采样温度和多样化提示来扩展操作

空间,确保多样化和最佳的轨迹集合。

AI 自我批评:在每个步骤中,基于 AI 的自我批评都会提供有价值的反馈,从而完善智能体的决策过程。这一步骤级反馈对于长期任务至关重要,因为稀疏信号通常会导致学习困难。

直接偏好优化(DPO):该算法通过从 MCTS 生成的数据构建偏好对以微调模型。这种离策略训练方法允许模型从聚合数据集(包括搜索过程中探索的次优分支)中有效地学习,从而提高复杂环境中

的成功率。

下面重点讲一下网页(Web-Page)端的 MCTS 算法。研究者探索了如何通过 MCTS 赋予智能体额外的搜索能力。

在以往的工作中,MCTS 算法通常由四个阶段组成:选择、扩展、模拟和反向传播,每个阶段在平衡探索与利用、迭代细化策略方面都发挥着关键作用。

研究者将网页智能体执行公式化为网页树搜索,其中状态由智能体历史和当前网页的 DOM 树组成。与国际象棋或围棋等棋盘游戏不同,研究者使用的复杂网络智能体操作空间是开放格式且可变的。

研究者将基础模型用作操作建议(action-proposal)分布,并在每个节点(网页)上采样固定数量的可能操作。一旦在浏览器中选择并执行一个操作,则会遍历下个网页,并且该网页与更新的历史记录

共同成为新节点。

研究者对反馈模型进行多次迭代查询,每次从列表中删除从上一次迭代中选择的最佳操作,直到对所有操作进行完整排序。下图 4 为完整的 AI 反馈过程。

扩展和回溯。研究者在浏览器环境中选择并执行一个操作以到达一个新节点(页面)。从选定的状态节点轨迹开始,他们使用当前策略 ????_???? 展开轨迹,直到到达终止状态。环境在轨迹结束时返回奖励

????,其中如果智能体成功则 ???? = 1,否则 ???? = 0。接下来,通过从叶节点到根节点自下而上地更新每个节点的值来反向传播此奖励,如下所示:

下图 3 展示了所有结果和基线。当让智能体在测试时能够搜索信息时,即为基础 xLAM-v0.1-r 模型应用 MCTS 时,成功率从 28.6% 提升到了 48.4%,接近平均人类表现的 50.0%,并且显著超过了仅通

过结果监督训练的零样本 DPO 模型的性能。

研究者进一步根据下图中概述的算法对基础模型进行了微调,结果比基础 DPO 模型提高了 0.9%。在精心训练的 Agent Q 模型上再应用 MCTS,智能体的性能提升到了 50.5%,略微超过了人类的平均

表现。

他们认为,即使智能体经过了大量的强化学习训练,在测试时具备搜索能力仍然是一个重要的范式转变。与没有经过训练的零样本智能体相比,这是一个显著的进步。

此外,尽管密集级监督比纯粹的基于结果的监督有所改善,但在 WebShop 环境中,这种训练方法的提升效果并不大。这是因为在这个环境里,智能体只需要做很短的决策路径,可以通过结果来学习信

用分配。

评估结果

研究者选择了让智能体在 OpenTable 官网上预订餐厅的任务来测试 Agent Q 框架在真实世界的表现如何。要完成这个订餐任务,智能体必须在 OpenTable 网站上找到餐厅的页面,选择特定的日期和时

间,并挑选符合用户偏好的座位,最后提交用户的联系方式,才能预定成功。

最初,他们对 xLAM-v0.1-r 模型进行了实验,但该模型表现不佳,初始成功率仅为 0.0%。因此,他们转而使用 LLaMa 70B Instruct 模型,取得了一些初步的成功。

不过由于 OpenTable 是一个实时环境,很难通过编程或自动化的方式进行测量和评估。因此,研究者使用 GPT-4-V 根据以下指标为每个轨迹收集奖励:(1) 日期和时间设置正确,(2) 聚会规模设置正

确,(3) 用户信息输入正确,以及 (4) 点击完成预订。如果满足上述所有条件,则视为智能体完成了任务。结果监督设置如下图 5 所示。

而 Agent Q 将 LLaMa-3 模型的零样本成功率从 18.6% 大幅提高到了 81.7%,这个结果仅在单日自主数据收集后便实现了,相当于成功率激增了 340%。在引入在线搜索功能后,成功率更是攀升至

95.4%。

更多技术细节和评估结果请参阅原论文。

参考链接:https://www.multion.ai/blog/introducing-agent-q-research-breakthrough-for-the-next-generation-of-ai-agents-with-planning-and-self-healing-capabilities

文章来自于公众号机器之心

发评论,每天都得现金奖励!超多礼品等你来拿

登录 后,在评论区留言并审核通过后,即可获得现金奖励,奖励规则可见: 查看奖励规则