来自伯克利人工智能研究(BAIR)实验室的研究人员开源深度学习模型 InstructPix2Pix,它可以遵循人类指令来编辑图像。InstructPix2Pix 在合成数据上进行训练,表现优于基线 AI 图像编辑模型。

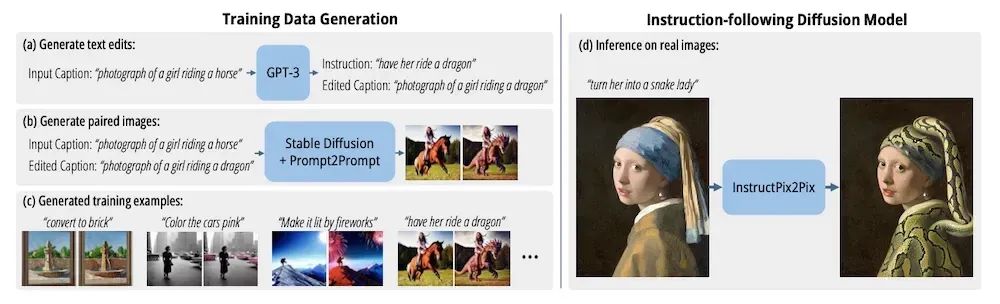

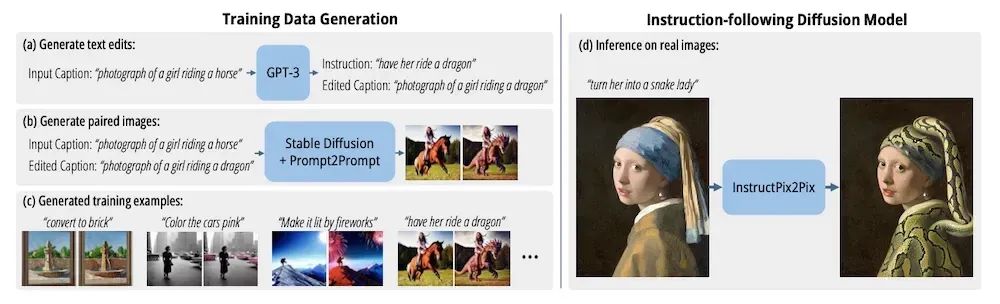

BAIR 团队在最近举行的 2023 年 IEEE/CVF 计算机视觉和模式识别(CVPR)大会上展示了他们的工作成果。他们先是生成了一个合成训练数据集,其中的训练样本是成对的图像以及用于将第一幅图像转换为第二幅图像的编辑指令。该数据集用于训练图像生成扩散模型,该模型可以接受基于文本的指令来编辑图像。例如,给定一张骑马的人的图片和提示词“让她变成骑龙”,它会输出原始图片,但原来的马被替换了龙。BAIR 的研究人员的表示:

尽管模型完全是在合成样本上进行训练的,但它实现了对任意真实图像和人类自然语言指令的零样本泛化。我们的模型能够进行直观的图像编辑,可以遵循人类指令执行多种编辑:替换对象、改变图像风格、修改设置、艺术媒介等。

之前的 AI 图像编辑能力通常是进行风格转换,流行的文本到图像生成模型(如 DALL-E 和 Stable Diffusion)也支持图像到图像风格转换操作。然而,使用这些模型进行有针对性的编辑仍然具有挑战性。最近,InfoQ 报道了微软的 Visual ChatGPT,它可以调用外部工具来编辑图像,前提是提供编辑操作的文本描述。

为了训练 InstructPix2Pix,BAIR 首先创建了一个合成数据集。为此,团队在一个由输入文字说明、编辑指令和期望输出文字说明组成的人类文本样本的小数据集上对 GPT-3 进行了微调。然后,这个微调模型被给予一个大型的输入图像文字说明数据集,从中生成了超过 450k 次编辑和输出文字说明。然后,团队将输入和输出文字说明馈送到预训练的 Prompt-to-Prompt 模型中,该模型根据文字说明生成成对的相似图像。

InstructPix2Pix 的架构,图片来源:https://arxiv.org/abs/2211.09800

研究人员鉴于这个数据集训练了基于 Stable Diffusion 的 InstructPix2Pix。为了评估其性能,团队将其输出与基线模型 SDEdit 进行了比较。他们使用两个指标之间的权衡:一致性(即输入图像和编辑后图像的 CLIP 嵌入之间的余弦相似度)和方向相似性(即编辑后文字说明中的变化与编辑后图像的变化在多大程度上保持一致)。在实验中,对于给定的方向相似性值,InstructPix2Pix 产生的图像比 SDEdit 具有更高的一致性。

人工智能研究员吴恩达在他的深度学习新闻邮件组“The Batch”中评价了 InstructPix2Pix:

这项工作简化了生成和人造图像的编辑操作,并提供了更一致的结果。巧妙地利用现有模型,模型作者能够使用相对较少的人类标记样本在新任务上训练他们的模型。

InstructPix2Pix 的代码可在 GitHub 上获取,模型和基于 Web 的演示可在 Huggingface 上访问。

文章转载自公众号AI前线,作者AI前线

发评论,每天都得现金奖励!超多礼品等你来拿

登录 后,在评论区留言并审核通过后,即可获得现金奖励,奖励规则可见: 查看奖励规则